Applied AI in der Chemie beginnt in der Regel nicht mit einem einzelnen Modell, sondern mit der Frage, wie Laborarbeit, Daten und Entscheidungen tatsächlich zusammenhängen. In vielen F&E-Umgebungen liegen bereits große Mengen an Informationen vor: Laborprotokolle, Rezepturen, Rohstoffdaten, Geräteexporte, Spektren, Chromatogramme, Prüfberichte, Stabilitätsdaten, Prozessparameter und Kommentare aus elektronischen Laborjournalen. Diese Daten sind jedoch häufig über verschiedene Systeme verteilt und unterschiedlich stark strukturiert. Ein Teil liegt in Tabellen vor, ein anderer Teil in Freitexten, PDFs oder Gerätesoftware. Für einzelne Chemikerinnen und Chemiker ist dieses Wissen oft nachvollziehbar, für eine systematische Auswertung durch KI-Modelle zunächst aber nur eingeschränkt nutzbar.

Ein konkretes Beispiel ist die Entwicklung einer wasserbasierten Beschichtung für metallische Oberflächen. Das F&E-Team sucht eine Formulierung, die gute Haftung, ausreichenden Korrosionsschutz, stabile Viskosität, kurze Trocknungszeit, geringe Emissionen und vertretbare Rohstoffkosten verbindet. Chemisch betrachtet ist das kein einzelnes Optimierungsproblem, sondern ein Zusammenspiel aus Bindemitteln, Pigmenten, Füllstoffen, Additiven, Vernetzern, Dispergiermitteln, pH-Wert, Partikelgrößenverteilung, Scherenergie und Prozessführung. Jede Rezeptur ist außerdem von Rohstoffchargen, Herstellreihenfolge, Temperatur, Rührzeit und Prüfbedingungen abhängig. Genau an dieser Stelle kann KI in der Chemie sinnvoll eingesetzt werden, sofern sie nicht isoliert betrachtet wird, sondern als Teil eines durchgängigen Arbeitsablaufs.

Der erste Schritt besteht darin, Laborprotokolle maschinenlesbar zu machen. In klassischen Protokollen stehen wichtige Informationen häufig in natürlicher Sprache. Dort heißt es zum Beispiel, dass ein Pigment langsam eingearbeitet wurde, bis keine Agglomerate mehr sichtbar waren, oder dass die Viskosität nach einer pH-Korrektur deutlich anstieg. Solche Aussagen enthalten relevante Prozessinformationen, sind aber für Modelle schwer vergleichbar, wenn sie nicht strukturiert werden. Eine KI-gestützte Protokollanalyse kann diese Texte in einzelne Arbeitsschritte zerlegen. Aus einem Freitext werden dann Operationen wie Zugabe, Rühren, Dispergieren, Erwärmen, Kühlen, Filtrieren, Neutralisieren oder Messen. Dazu werden Materialien, Mengen, Zeiten, Temperaturen, Drehzahlen, Reihenfolgen und Beobachtungen extrahiert. Das Ziel ist nicht, die chemische Bewertung zu ersetzen, sondern Versuche so zu beschreiben, dass ähnliche Abläufe später gefunden, verglichen und ausgewertet werden können.

Im Beispiel der Beschichtungsentwicklung wird dadurch nachvollziehbar, ob zwei Rezepturen wirklich nur in der Additivdosierung unterschieden wurden oder ob auch die Reihenfolge der Zugabe, die Dispergierzeit oder die Temperaturführung verschieden waren. Das ist wichtig, weil scheinbar kleine Unterschiede in der Herstellung zu deutlich unterschiedlichen Messergebnissen führen können. Eine Rezeptur, die im Labor stabil erscheint, kann bei veränderter Scherung oder anderer Rohstoffcharge instabil werden. Wenn Protokolldaten strukturiert vorliegen, lassen sich solche Zusammenhänge systematischer untersuchen.

Der zweite Schritt betrifft die Formulierungsentwicklung. Formulierungen bestehen meist aus vielen Komponenten, deren Wirkungen nicht unabhängig voneinander sind. Ein Dispergiermittel kann die Partikelverteilung verbessern, gleichzeitig aber Schaumbildung oder Wasserempfindlichkeit beeinflussen. Ein Bindemittel kann die Haftung erhöhen, aber die Trocknung verlangsamen. Eine Erhöhung des Feststoffgehalts kann Kosten und Emissionen verbessern, aber die Viskosität verschlechtern. Klassische Versuchplanung stößt bei solchen Wechselwirkungen schnell an Grenzen, weil der experimentelle Raum groß ist und nicht jede Kombination getestet werden kann.

KI-Modelle können hier als Surrogatmodelle eingesetzt werden. Sie lernen aus vorhandenen Rezepturen, Prozessparametern und Messergebnissen, welche Zusammenhänge zwischen Zusammensetzung und Eigenschaften wahrscheinlich sind. Als Eingaben dienen beispielsweise Massenanteile, Feststoffgehalte, Pigmentvolumenkonzentrationen, Rohstoffkennwerte, Additivklassen, pH-Werte, Dispergierzeiten und Temperaturprofile. Als Ausgaben werden Zielgrößen wie Viskosität, Haftung, Glanz, Kratzfestigkeit, Korrosionsschutz, Sedimentationsverhalten oder Lagerstabilität betrachtet. Da viele Zielgrößen gleichzeitig relevant sind, geht es selten um die Maximierung eines einzelnen Werts. Häufig müssen mehrere Eigenschaften gegeneinander abgewogen werden.

In einem praktischen Workflow würde das Team zunächst historische Formulierungen und Prüfwerte zusammenführen.

Anschließend wird geprüft, welche Daten ausreichend konsistent sind. Unterschiedliche Einheiten, abweichende Prüfmethoden oder uneinheitliche Rohstoffbezeichnungen müssen bereinigt werden, bevor ein Modell trainiert werden kann. Danach kann ein erstes Modell abschätzen, welche Rezepturbereiche vielversprechend sind und wo die Unsicherheit hoch ist. Auf dieser Grundlage schlägt ein aktives Lernverfahren neue Experimente vor. Diese Vorschläge sind nicht notwendigerweise die Rezepturen, die sofort die beste Leistung erwarten lassen. Sie können auch gezielt Bereiche untersuchen, in denen das Modell noch wenig Wissen hat. Dadurch wird die nächste Versuchsreihe nicht nur zur Validierung, sondern auch zur Verbesserung des Modells genutzt.

Nach jeder Laborrunde werden die neuen Messwerte zurückgeführt. Das Modell wird aktualisiert, die Unsicherheit verändert sich, und die nächste Versuchsreihe kann geplant werden. Auf diese Weise entsteht ein Kreislauf aus Hypothese, Experiment, Messung und Modellanpassung. Der Nutzen liegt darin, Versuchsräume gezielter zu durchsuchen und nicht jede Entscheidung ausschließlich aus Erfahrungswissen oder vollständigen Faktorplänen abzuleiten. Die chemische Interpretation bleibt dabei notwendig. Ein Modell kann Korrelationen erkennen und Kandidaten vorschlagen, aber es versteht nicht automatisch, ob ein vorgeschlagener Rohstoff regulatorisch problematisch, schwer beschaffbar, sicherheitstechnisch kritisch oder im Scale-up ungeeignet ist.

Der dritte Bereich ist die Syntheseplanung. In vielen Entwicklungsprojekten reicht es nicht aus, verfügbare Rohstoffe neu zu kombinieren. Manchmal werden neue Additive, Vernetzer, Liganden, Monomere oder Zwischenprodukte benötigt. Dann stellt sich die Frage, über welche Route ein Zielmolekül hergestellt werden kann und welche Ausgangsstoffe, Reaktionsbedingungen und Nebenprodukte zu erwarten sind. KI-gestützte Retrosynthese kann ausgehend von einer Zielstruktur mögliche Vorstufen und Reaktionsschritte vorschlagen. Dabei werden Molekülstrukturen häufig in textähnlichen Formaten wie SMILES verarbeitet. Modelle lernen aus bekannten Reaktionsdaten, welche Transformationen unter welchen Bedingungen plausibel sind.

Auch hier ist der Einsatz in der Praxis nicht als automatische Entscheidung zu verstehen. Ein Modell kann mögliche Routen erzeugen, aber die Bewertung erfordert chemisches Fachwissen. Verfügbarkeit von Edukten, Selektivität, Ausbeute, Reinigung, Lösungsmittelwahl, Temperaturführung, gefährliche Zwischenprodukte, Nebenreaktionen und Skalierbarkeit müssen geprüft werden. In unserem Beispiel könnte das Team ein Additiv mit besserer Verträglichkeit im wässrigen System suchen. Ein KI-System könnte strukturell ähnliche Verbindungen identifizieren, Synthesewege vorschlagen und bekannte Reaktionsklassen berücksichtigen. Die Auswahl der tatsächlich zu testenden Route bleibt jedoch eine fachliche Entscheidung, die auch Sicherheits- und Qualitätsaspekte einschließt.

Der vierte Bereich ist der Wissensgraph. Er verbindet die Daten aus Protokollen, Formulierungen, Synthesen, Rohstoffen, Analytik und Prüfungen. Ein Wissensgraph beschreibt nicht nur einzelne Datensätze, sondern ihre Beziehungen. Eine Rohstoffcharge wurde in einer bestimmten Formulierung verwendet. Diese Formulierung wurde nach einer bestimmten Protokollversion hergestellt. Das erzeugte Muster wurde mit einer bestimmten Methode geprüft. Das Ergebnis wurde unter bestimmten Lagerbedingungen gemessen. Ein Additiv gehört zu einer chemischen Klasse und erfüllt eine bestimmte Funktion. Eine Syntheseroute erzeugt ein Zwischenprodukt, das wiederum in einer Formulierung eingesetzt wurde.

Durch solche Beziehungen wird Laborwissen abfragbar. Das Team kann dann untersuchen, welche Rezepturen mit ähnlicher Pigmentvolumenkonzentration gute Haftung, aber schlechte Lagerstabilität gezeigt haben. Es kann prüfen, ob ein Viskositätsanstieg mit einer bestimmten Rohstoffcharge, einer geänderten Zugabereihenfolge oder einer abweichenden pH-Korrektur zusammenhängt. Es kann vergleichen, welche Additivklassen in wasserbasierten Systemen häufiger zu Schaumbildung geführt haben oder welche Syntheserouten zu Nebenprodukten führten, die später analytisch auffällig waren. Solche Fragen sind in getrennten Tabellen, PDF-Protokollen und Geräteordnern nur mit hohem manuellem Aufwand zu beantworten.

Für KI-Anwendungen ist der Wissensgraph außerdem eine wichtige Kontextschicht. Ein Sprachmodell, das auf Laborwissen zugreifen soll, benötigt nicht nur Textfragmente, sondern Informationen darüber, welche Begriffe, Substanzen, Methoden und Ergebnisse zusammengehören. Ohne diese semantische Struktur besteht die Gefahr, dass ähnliche, aber chemisch unterschiedliche Sachverhalte vermischt werden. Ein Bindemittel als Rohstoff, ein Monomer als Synthesebaustein, ein Additiv als Hilfsstoff und ein Nebenprodukt aus einer Reaktion dürfen nicht nur als beliebige Stoffnamen behandelt werden. Der Kontext entscheidet, wie die Information zu interpretieren ist.

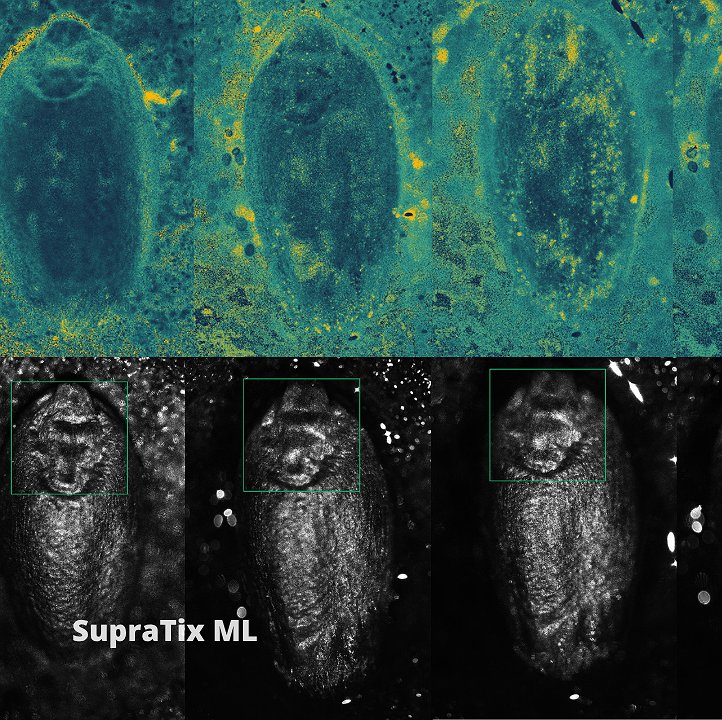

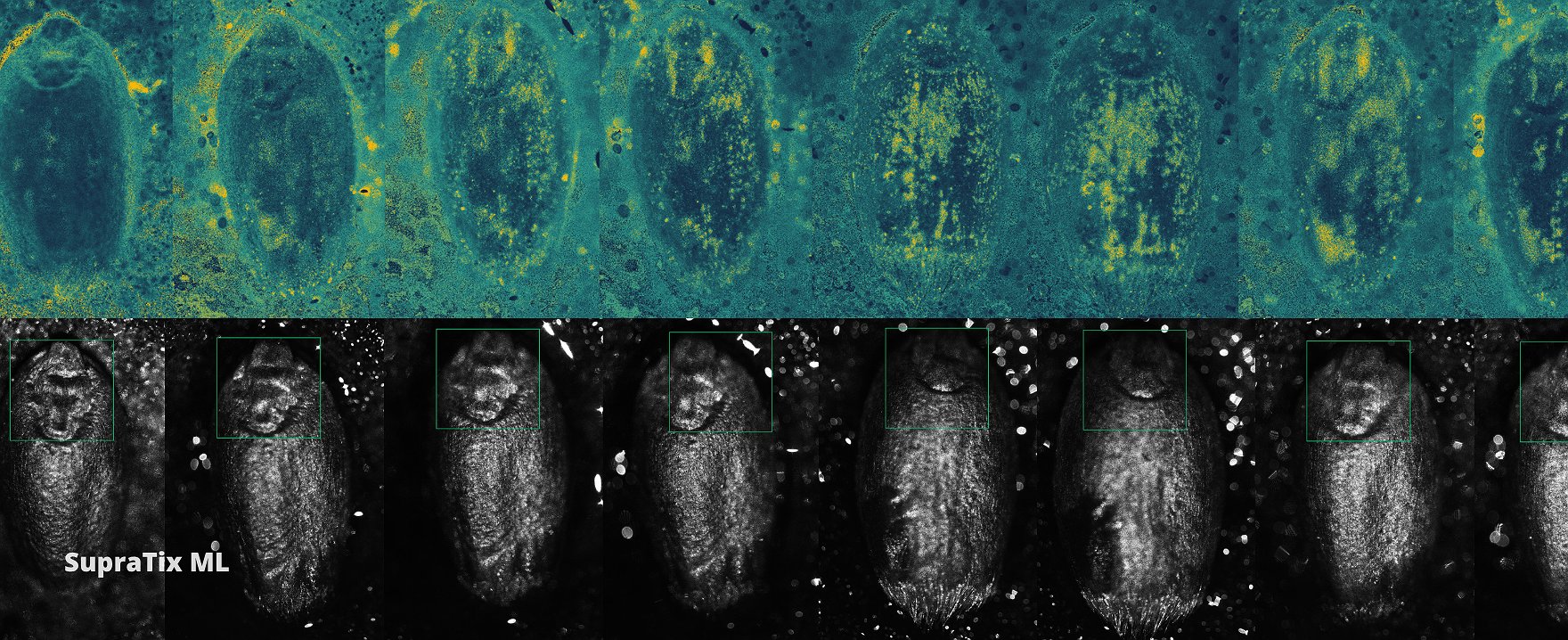

Die Datenarten in einem solchen System sind entsprechend vielfältig. Molekülstrukturen, Reaktionsdaten, Rezepturdaten, Rohstoffspezifikationen, Prozesszeitreihen, analytische Rohdaten, Spektren, Bilder, Prüfwerte und Freitextprotokolle erfüllen unterschiedliche Funktionen. Strukturformeln und Reaktionsdaten unterstützen Syntheseplanung und Stoffeigenschaftsvorhersage. Rezeptur- und Prozessdaten sind Grundlage für Formulierungsmodelle. Spektren, Chromatogramme und thermische Analysen helfen bei Qualitätskontrolle und Strukturvalidierung. Bilddaten aus Mikroskopie oder Oberflächenanalyse können Hinweise auf Phasentrennung, Agglomeration oder Defekte liefern. Freitexte aus Laborjournalen enthalten Beobachtungen, die in numerischen Daten oft fehlen. Erst die Verbindung dieser Datenarten ermöglicht robuste Auswertungen.

Ein technischer Aufbau für Applied AI in der Chemie beginnt deshalb mit Datenintegration. Elektronische Laborjournale, LIMS-Systeme, Geräteexporte, Rohstoffdatenbanken und gegebenenfalls ERP-Systeme müssen so verbunden werden, dass Proben, Chargen, Rezepturen, Messungen und Methoden eindeutig referenzierbar sind. Danach folgt die Normalisierung. Stoffnamen, Einheiten, Chargenbezeichnungen, Methodenvarianten und Synonyme müssen vereinheitlicht werden. Anschließend kann eine semantische Schicht aufgebaut werden, in der Ontologien und Wissensgraphen beschreiben, was die Daten bedeuten. Erst darauf sollten Modelle für Protokollextraktion, Eigenschaftsvorhersage, Formulierungsoptimierung, Retrosynthese oder Anomalieerkennung aufsetzen.

Ein häufiger Fehler besteht darin, direkt mit einem Modelltraining zu beginnen, ohne den Laborprozess und die Datenqualität ausreichend zu verstehen. Historische Daten enthalten oft Lücken und Verzerrungen. Fehlgeschlagene Experimente werden seltener dokumentiert als erfolgreiche. Prüfmethoden ändern sich über die Jahre. Rohstoffnamen werden uneinheitlich verwendet. Manche Prozessparameter wurden nicht erfasst, weil sie im Labor als selbstverständlich galten. Für Modelle sind solche fehlenden Informationen jedoch relevant. Wenn eine Rezeptur nur deshalb gut abschneidet, weil sie unter anderen Bedingungen hergestellt oder geprüft wurde, lernt das Modell möglicherweise den falschen Zusammenhang.

Ein realistischer Einstieg besteht daher aus einem begrenzten Anwendungsfall. Im Beschichtungsbeispiel könnte zunächst nur eine Produktfamilie betrachtet werden, etwa wasserbasierte Korrosionsschutzformulierungen mit einem bestimmten Bindemittelsystem. Für diese Produktfamilie werden die wichtigsten historischen Rezepturen, Rohstoffdaten, Protokolle und Prüfwerte gesammelt. Anschließend wird ein gemeinsames Datenschema erstellt. Protokolle werden in Arbeitsschritte und Parameter zerlegt. Rohstoffnamen werden vereinheitlicht. Messwerte werden mit Methoden und Bedingungen verknüpft. Danach kann ein erstes Modell trainiert werden, das ausgewählte Zielgrößen wie Viskosität, Haftung und Lagerstabilität abbildet.

Der erste Nutzen entsteht oft schon vor dem eigentlichen Modell. Wenn Daten zusammengeführt und strukturiert werden, werden Inkonsistenzen sichtbar. Das Team erkennt, welche Prüfwerte vergleichbar sind, welche Rezepturen unvollständig dokumentiert wurden und welche Prozessparameter künftig systematisch erfasst werden sollten. Das Modell kann anschließend helfen, Hypothesen zu priorisieren und neue Versuche vorzuschlagen. Nach den ersten neuen Laborergebnissen zeigt sich, ob die Modellvorschläge chemisch sinnvoll waren und ob die Datenbasis ausreichend ist. Auf dieser Grundlage kann der Workflow erweitert werden.

Applied AI in der Chemie ist damit weniger ein einzelnes Werkzeug als eine Arbeitsweise. Protokolle werden so erfasst, dass sie später ausgewertet werden können. Formulierungen werden nicht nur dokumentiert, sondern mit Prozess- und Prüfbedingungen verknüpft. Synthesevorschläge werden modellgestützt erzeugt, aber fachlich geprüft. Wissensgraphen verbinden Materialien, Methoden, Experimente und Ergebnisse. Der Nutzen entsteht, wenn jedes Experiment nicht nur ein einzelnes Ergebnis liefert, sondern das gemeinsame Laborwissen verbessert.